Ведущая веб-камера с искусственным интеллектом

Когда слышишь ?ведущая веб-камера с искусственным интеллектом?, первое, что приходит в голову — это, наверное, какой-то футуристический гаджет, который сам всё видит, понимает и идеально кадрирует. Но на практике, за этими громкими словами часто скрывается довольно специфичный набор функций, и далеко не все из них действительно ?интеллектуальны?. Многие коллеги из индустрии до сих пор путают базовое отслеживание движения по контрасту с настоящим искусственным интеллектом, который способен на семантический анализ сцены. Вот об этой разнице и о том, как это выглядит в железе, стоит поговорить подробнее.

Что на самом деле умеет ?AI? в камере сегодня?

Если отбросить маркетинг, то под искусственным интеллектом в конференц-камерах чаще всего подразумевается набор алгоритмов компьютерного зрения. Основная задача — автоматическое кадрирование говорящего. Но здесь есть нюанс: ранние системы просто ловили движение или искали самый контрастный объект. Это приводило к курьёзам, когда в фокус попадал человек, вставший поправить штору, а не докладчик. Современные же системы, которые можно назвать ведущая веб-камера с претензией, учатся распознавать именно лица, определять, кто говорит (анализ аудиопотока в связке с видео), и даже предсказывать, когда человек может вновь начать речь. Это уже другой уровень.

Второй ключевой момент — качество в сложных условиях. Алгоритмы шумоподавления для видео, стабилизации изображения при дрожании, коррекция освещения с задней засветкой — всё это теперь часто завязано на нейросетевые модели. Они работают прямо на процессоре камеры. Но тут встаёт вопрос баланса: чем сложнее модель, тем больше требуется вычислительной мощности, а это тепло и цена. Поэтому не каждый производитель, заявляющий об ИИ, вкладывает в это реальные ресурсы. Часто это просто хорошо прописанный софтверный фильтр.

Из личного опыта: мы как-то тестировали партию камер для большого переговорного зала. Одна из моделей гордо заявляла об ?AI Tracking?. На практике её алгоритм сбивался, когда в кадре было больше трёх человек в очках — видимо, блики от линз путали детектор. Пришлось детально разбираться с вендором, оказалось, что обучающая выборка для их модели была недостаточно разнообразной. Это типичная проблема — искусственный интеллект только тогда хорош, когда он обучен на реальных, а не студийных данных.

Аппаратная начинка: где живёт этот интеллект?

Говоря о технической стороне, нельзя не упомянуть производителей, которые контролируют весь цикл. Вот, например, ООО Шэньчжэнь Сэньпужуйдэ Электроника. Их сайт szsunrupid.ru прямо указывает на компетенции в полном цикле: от разработки и изготовления пресс-форм до производства. Это важный момент. Когда компания сама делает литьё под давлением и сборку, у неё есть прямая возможность оптимизировать конструктив под конкретную электронную начинку — например, под тот самый процессор для ИИ-алгоритмов, чтобы обеспечить ему лучший теплоотвод.

Их портфель, судя по описанию, сфокусирован на продуктах для видеоконференций: PTZ-камеры, веб-камеры, контроллеры. Для ведущей веб-камеры с искусственным интеллектом такая вертикальная интеграция — большой плюс. Потому что можно не просто купить готовый сенсор и софт, а спроектировать оптику и матрицу с расчётом на программные улучшения. Скажем, сделать пиксели чуть крупнее для лучшего светопоглощения в условиях низкой освещённости, зная, что нейросеть потом вытянет детализацию. Без собственного производства такие тонкие настройки почти невозможны.

На деле это выглядит так: инженеры компании-производителя вместе с алгоритмистами садятся и решают, какой DSP или специализированный чип (типа NVIDIA Jetson или аналогов) поставить, как развести плату, чтобы минимизировать помехи для сенсора, и какую версию прошивки с моделями ИИ зашить. Это и есть та самая ?кухня?, о которой редко пишут в пресс-релизах, но которая определяет, будет ли камера стабильно работать в режиме автотрекинга 8 часов подряд или начнёт ?задумываться? и перегреваться.

Сценарии применения и подводные камни

Где действительно раскрывается потенциал такой камеры? Очевидный сценарий — гибридные совещания, где часть людей в зале, часть удалённо. Камера должна плавно вести за активным говорящим, давать возможность предустановок на группу, а при необходимости — захватывать общий план. Но вот проблема, с которой мы столкнулись: в длинных переговорах люди часто откидываются на спинку кресла, выходят из ?портретной? зоны кадра. Простой трекинг по лицу тут может дать сбой — лицо стало слишком мелким. Приходится настраивать логику: если говорящий отдалился, стоит ли камере зумировать на него, теряя общий контекст комнаты, или переключиться на другого участника? Идеального автоматического решения нет, поэтому в топовых моделях остаётся важной возможность быстрого ручного управления через джойстик или ПО.

Другой тонкий момент — конфиденциальность. Алгоритмы ИИ, обрабатывающие видео, могут работать локально на устройстве или отправлять данные в облако. Для корпоративного сектора локальная обработка — часто обязательное требование. Значит, вся ?интеллектуальная? нагрузка ложится на чип внутри камеры. Это опять упирается в компетенции производителя в области аппаратного обеспечения и оптимизации кода. Компании, подобные Сэньпужуйдэ, которые сами занимаются производством, здесь могут иметь преимущество, быстрее внедряя более мощные и энергоэффективные чипсеты в свои новые модели.

Был у меня опыт внедрения таких систем в учебных аудиториях. Казалось бы, идеальный кейс: лектор двигается, пишет на доске. Но оказалось, что стандартный алгоритм, обученный на офисных сценах, плохо справлялся, когда преподаватель поворачивался к доске спиной — он терял лицо и начинал паниковать, пытаясь найти новый объект. Решение потребовало кастомизации: мы добавили в логику признак ?объект в движении определённого размера? как fallback-опцию, когда лицо не видно. Это небольшая, но важная доработка, которая не делается массово, а требует диалога с поставщиком, имеющим гибкость в разработке.

Будущее: куда движется развитие?

Если смотреть вперёд, то простое отслеживание говорящего станет базовой, ожидаемой функцией. Следующий шаг — семантическое понимание сцены. Например, камера сможет определять, что группа людей ведёт оживлённую дискуссию, и автоматически переходить в групповой план, или, наоборот, фиксировать, что кто-то один начал презентацию у экрана. Это потребует более сложных многомодальных моделей (аудио+видео+возможно, анализ содержимого экрана).

Ещё один тренд — интеграция с экосистемами для видеосвязи (Teams, Zoom, и т.д.) на более глубоком уровне. Не просто как устройство ввода видео, а как интеллектуальный агент, который может предоставлять сервису метаданные: ?сейчас в кадре 4 человека?, ?ключевой спикер — женщина в центре?, ?документ на доске не в фокусе?. Это откроет новые возможности для автоматизации протоколов встреч. Но здесь снова встаёт вопрос стандартизации и открытости API, что пока является вызовом для всей отрасли.

Для производителей полного цикла, таких как ООО Шэньчжэнь Сэньпужуйдэ Электроника, это открывает поле для развития. Их экспертиза в создании аппаратной платформы под конкретные задачи видеоконференц-связи может стать критически важной, когда потребуется устанавливать более производительные и специализированные AI-ускорители следующего поколения. Способность быстро прототипировать и менять конструктив, имея собственное литьё и сборку, даст фору в этой гонке.

Итоговые соображения для практика

Выбирая ведущую веб-камеру с искусственным интеллектом, в итоге нужно смотреть не на красивые слова в описании, а на несколько практических вещей. Во-первых, на реальные демо или тест в условиях, максимально приближённых к вашим: при том же освещении, с тем же количеством людей. Во-вторых, на возможность тонкой настройки логики работы ИИ под свои нужды (через ПО производителя). В-третьих, на репутацию и экспертизу вендора в области именно производства аппаратуры, а не просто торговли.

Стоит задавать прямые вопросы: где выполняется обработка ИИ (на устройстве или в облаке)? на какой чипсет? можно ли обновлять модели ИИ через прошивку? Как компания обеспечивает теплорасчёт для стабильной работы? Ответы на них покажут, насколько серьёзно производитель подходит к теме. Те, кто, как Сэньпужуйдэ, вкладываются в полный цикл, обычно могут дать более детальные и технически обоснованные ответы, потому что они контролируют процесс от схемы до корпуса.

В конечном счёте, ?искусственный интеллект? в камере — это пока не волшебный чёрный ящик, а довольно конкретный инструмент. Его эффективность определяется качеством ?железа?, грамотностью алгоритмов и — что часто забывают — пониманием производителем реальных рабочих сценариев. И именно последний пункт часто отличает просто устройство от действительно ведущего решения на рынке.

Соответствующая продукция

Соответствующая продукция

Самые продаваемые продукты

Самые продаваемые продукты-

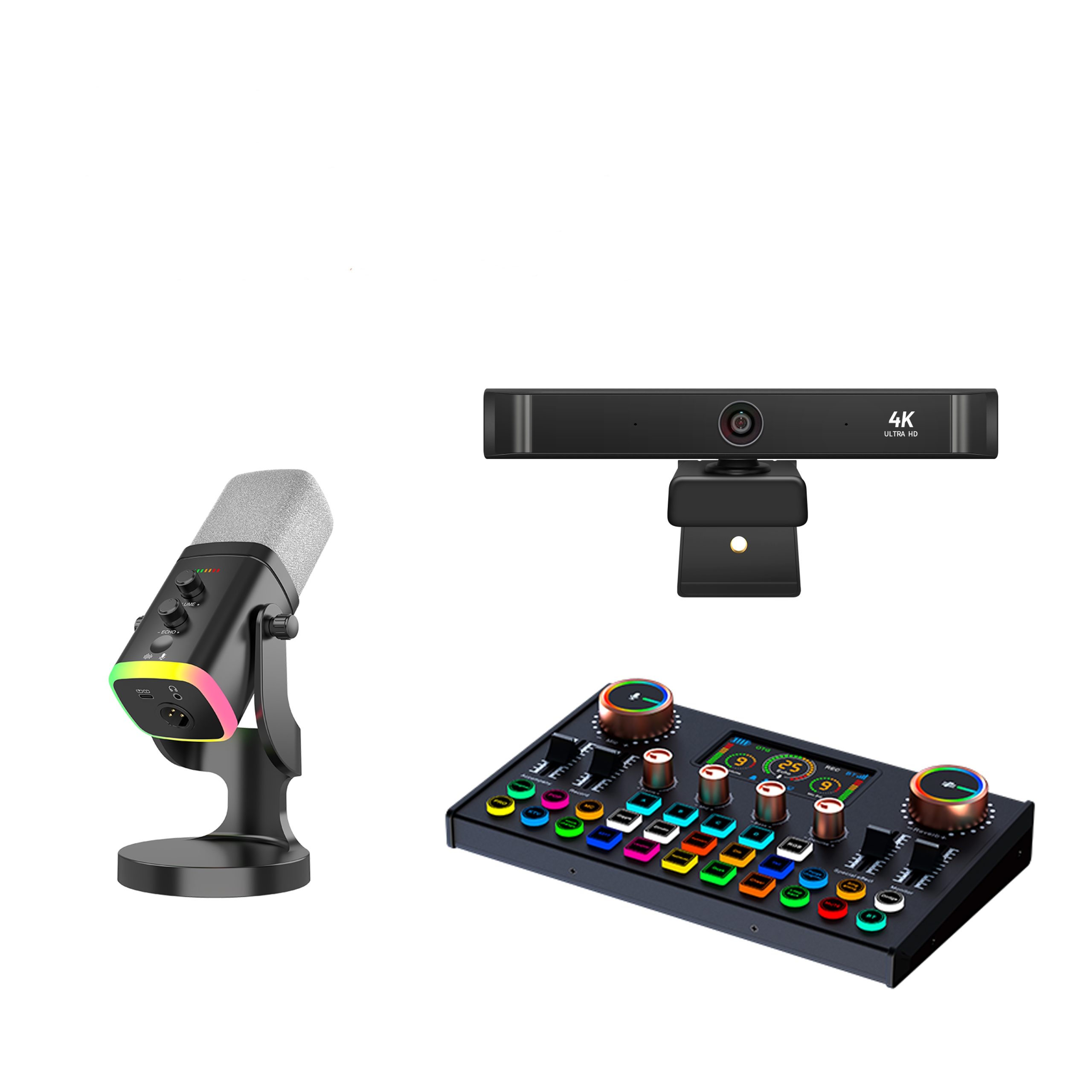

Комплект оборудования для подкаста, комплект студии звукозаписи, звуковая карта для живого звука

Комплект оборудования для подкаста, комплект студии звукозаписи, звуковая карта для живого звука -

4K60 PTZ-камера вещательного класса, 25-кратный зум, USB3.0, 12G-SDI, HDMI, IP, PoE, NDI HX3, автотрекинг

4K60 PTZ-камера вещательного класса, 25-кратный зум, USB3.0, 12G-SDI, HDMI, IP, PoE, NDI HX3, автотрекинг -

M3-B Всенаправленный конференц-микрофон «всё в одном» — зона покрытия 40 м²

M3-B Всенаправленный конференц-микрофон «всё в одном» — зона покрытия 40 м² -

4K 12x оптический зум 8.29MP с HDMI USB3.0 RJ45 SDI вещания класса Ptz камеры до 4K @ 60 кадров в секунду для живого потока использования

4K 12x оптический зум 8.29MP с HDMI USB3.0 RJ45 SDI вещания класса Ptz камеры до 4K @ 60 кадров в секунду для живого потока использования -

Комплект оборудования для подкаста, комплект студии звукозаписи, звуковая карта для живого звука

Комплект оборудования для подкаста, комплект студии звукозаписи, звуковая карта для живого звука -

Профессиональный 4-канальный мини-видеомикшер HDMI для прямых трансляций, видеоконференций и голосования — аудио- и видеомикшер

Профессиональный 4-канальный мини-видеомикшер HDMI для прямых трансляций, видеоконференций и голосования — аудио- и видеомикшер -

Веб-камера 4K UHD для ноутбука с 3-уровневой подсветкой и встроенным микрофоном для прямых трансляций или конференций

Веб-камера 4K UHD для ноутбука с 3-уровневой подсветкой и встроенным микрофоном для прямых трансляций или конференций -

PTZ-камера с 30-кратным оптическим зумом, 1080P 60FPS, AI-автотрекинг, HDMI, 3G-SDI, USB3.0, PoE

PTZ-камера с 30-кратным оптическим зумом, 1080P 60FPS, AI-автотрекинг, HDMI, 3G-SDI, USB3.0, PoE -

W007 Новая веб-камера для ПК с разрешением 1080p, USB-камера со встроенным микрофоном для прямых трансляций школьных онлайн-уроков

W007 Новая веб-камера для ПК с разрешением 1080p, USB-камера со встроенным микрофоном для прямых трансляций школьных онлайн-уроков -

4K профессиональная PTZ-камера для ТВ-вещания, FREE D Vistual Studio, NDI HX3, SRT, Dual 12G-SDI

4K профессиональная PTZ-камера для ТВ-вещания, FREE D Vistual Studio, NDI HX3, SRT, Dual 12G-SDI -

Веб-камера 4K USB2.0 Ultra HD с фиксированным фокусом, разрешением 4K и встроенным микрофоном для потокового вещания и видеоконференций

Веб-камера 4K USB2.0 Ultra HD с фиксированным фокусом, разрешением 4K и встроенным микрофоном для потокового вещания и видеоконференций -

Daisy Chain микрофон полный дуплекс 360 градусов Omni направленный беспроводной спикерфон для аудио конференц-системы

Daisy Chain микрофон полный дуплекс 360 градусов Omni направленный беспроводной спикерфон для аудио конференц-системы

Связанный поиск

Связанный поиск- Отличный микшерный пульт прямого вещания

- Оптовая Full HD веб-камера

- Производители OCR сканеров

- Производители 360-градусных камер для конференций все в одном

- Заводы которые оптовой компьютерные веб-камеры

- Китай 4k 60fps веб-камера

- Оптовые производители HD веб-камер с микрофоном

- Оптовая продажа C270 HD веб-камеры

- Оптовая джойстик птз

- Китай Logitech hd pro c920 веб-камера завод

.png)